電氣學院智能決策與控制技術研究團隊依托學校控制科學與工程一級學科,根據國家中長期發展規劃、行業需求及未來科技發展趨勢,研究定位于機器人智能決策與控制領域,目前專注于具身智能操控技術(感知與認知、決策、控制、執行)的理論與應用研究。近期,智能決策與控制技術研究團隊在具身智能感知與認知研究方面取得系列成果,研究成果均以我校為第一單位發表在人工智能及工程技術領域知名期刊。

具身智能強調智能體在物理世界中身體與環境之間的交互,這種交互包含感知與認知兩個關鍵任務。感知是具身智能系統最基本的功能之一,其感知機制通常涉及多種傳感器的融合,包括視覺、觸覺、聽覺和運動傳感器等,通過這些傳感器,智能體能夠實時感知環境,對其狀態進行動態評估。而認知則是指智能體在感知的基礎上,對獲取的信息進行理解和處理,從而做出決策和行動的能力。

在追求更高層次智能的過程中,具身智能需要通過多模態信息融合機制整合來自多個感知渠道的信息,以全面理解周圍環境和操作對象。目前,大多數多模態感知研究集中在基于視覺的融合上,且大多僅涉及兩種模態的融合,而三種或更多模態的融合則鮮有探索。

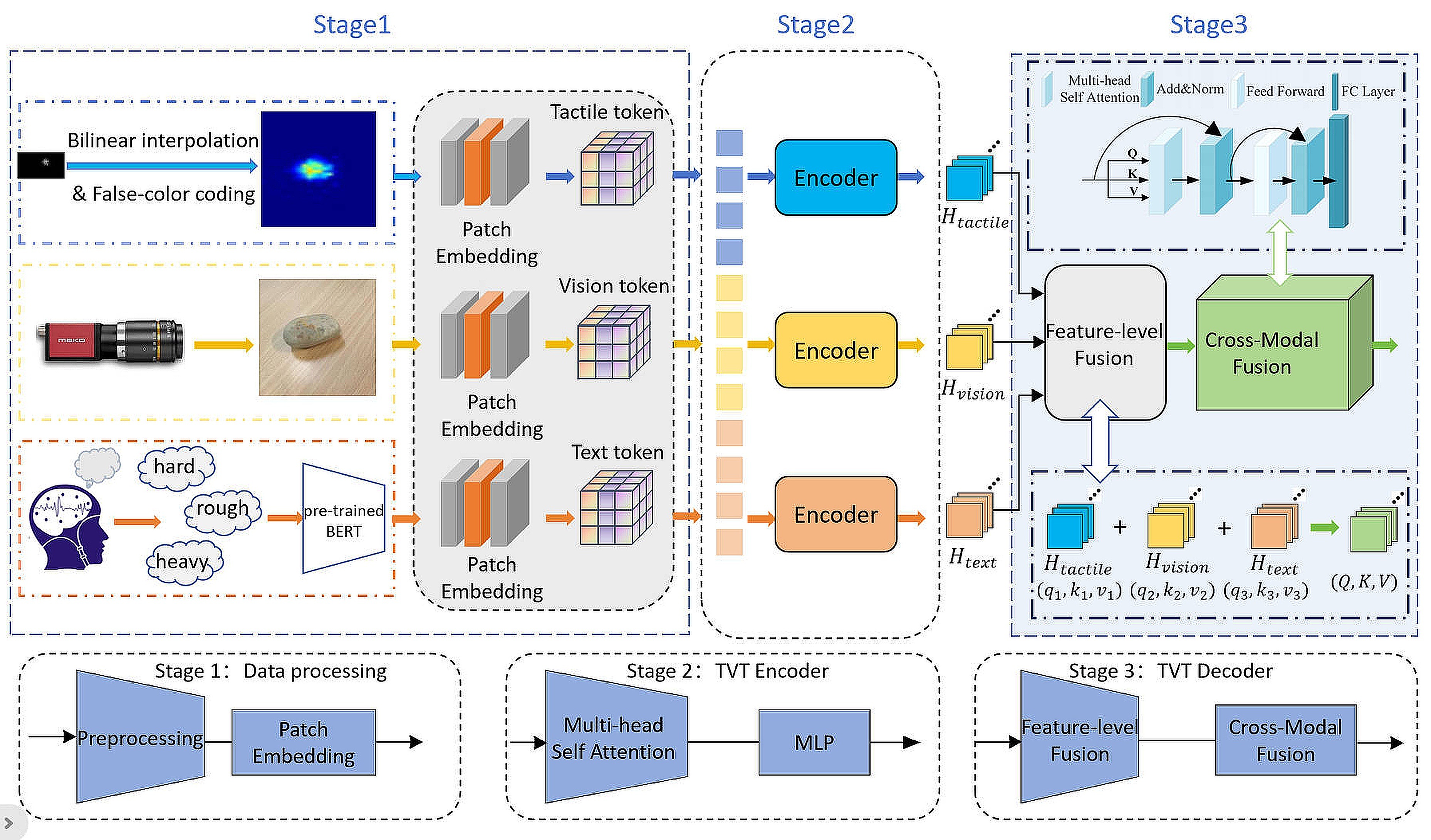

針對這一問題,研究團隊提出了TVT-Transformer(Tactile-Visual-Textual:觸覺-視覺-文本),這是一個新的框架,用于從觸覺、視覺和語義文本三種模態數據中聯合學習。該方法利用注意力機制深入挖掘和對齊來自不同感知模態的信息,使模型能夠有效地整合觸覺、視覺和語義文本數據的特征,通過跨模態交互實現更深層次的信息融合。相關研究成果以“TVT-Transformer: A Tactile-Visual-Textual Fusion Network for Object Recognition”為題,發表在人工智能領域知名期刊《Information Fusion》(IF 14.8,中國科學院一區,Top期刊)上。

該框架引入了一種新穎的語義表征方法,通過結合人類對物體的觀察和觸摸感知,生成標準化的語義描述并利用預訓練進行編碼,將語義文本與視覺和觸覺信息對齊,然后將觸覺、視覺和文本模態整合到一個統一的矩陣中,隨后利用注意力機制進行跨注意力計算,從而實現更準確、高效的跨模態特征整合與理解。文本模態提供了語義支持,增強了信息的整合效果和對象識別的準確性。這種方法增強了特征表達能力,在多模態數據整合方面實現了顯著的性能提升,并提高了對象識別的準確性。本研究不僅為多模態信息融合領域提供了新的視角,還為具身智能的發展提供了強有力的技術支持。TVT-Transformer框架具有廣泛的應用潛力,未來有望在智能機器人、人機交互和輔助決策等領域發揮重要作用。

論文鏈接:https://linkinghub.elsevier.com/retrieve/pii/S1566253525000168

大腦是一個由神經元、局部回路和功能區組成的復雜系統。神經通路連接不同的區域并協作完成復雜的認知和行為功能。EEGNet被認為是一種非常成功的基于卷積網絡的融合腦電圖(EEG)信號解碼模型。但是有兩點可以改進:首先,激活的大腦區域可能因不同的BCI任務而異;其次,高密度腦電圖信號有可能提供更豐富的大腦信息。然而目前的大多數研究只是將來自不同通道的EEG信號疊加在一起,忽略了腦模型上EEG電極的空間關系以及不同腦功能區域之間的功能連接。

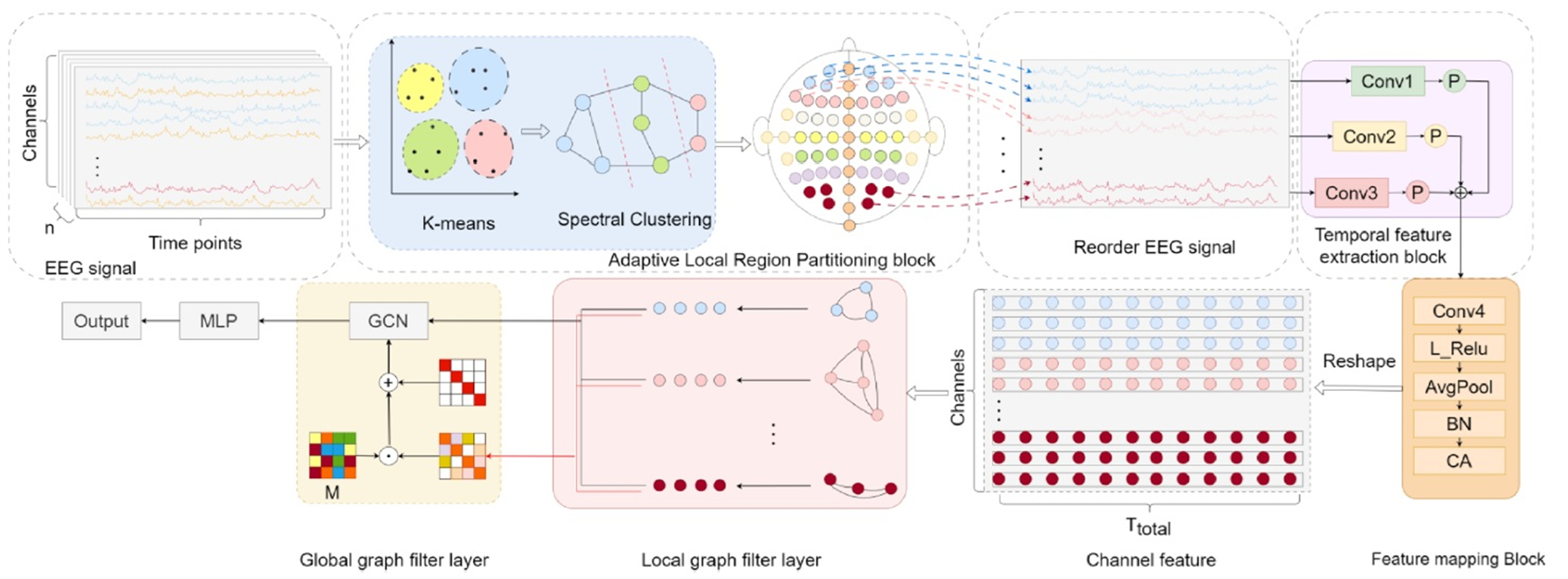

為了研究功能區域內和功能區域之間的大腦活動,研究團隊提出了一種自適應局部全局圖表示網絡(ALGGNet)。相關研究成果以“ALGGNet: An Adaptive Local-Global-Graph Representation Network for Brain-Computer Interfaces”為題,發表在人工智能領域知名期刊《Knowledge-Based Systems》(IF 7.2,中國科學院一區,Top期刊)上。

ALGGNet網絡由三個基本組件組成:自適應局部區域劃分塊、時間學習塊和圖學習塊。首先采用神經科學中的腦功能區概念,并采用雙聚類算法自適應地為特定數據集生成類腦功能區。然后根據聚類結果對EEG通道進行重新排序。隨后,EEG信號通過時間信息處理階段和圖學習階段。時間信息處理階段主要包括多尺度時間卷積塊和具有坐標注意力機制的特征映射塊。圖學習階段包括聚集關于局部區域的信息的圖過濾器和學習局部區域之間復雜關系的全局圖卷積網絡。該網絡適用于腦機接口應用,包括運動圖像腦電圖信號的解碼和情緒識別。

論文鏈接:https://www.sciencedirect.com/science/article/abs/pii/S0950705125001431

EEG和功能性近紅外光譜(fNIRS)信號融合可彌補單一模態的不足,全面反映大腦活動模式。然而兩者在物理本質、采樣頻率和噪聲特性上差異顯著,這給融合帶來挑戰。如何有效融合這兩種信號,保留各自優勢,是當前亟待解決的問題。

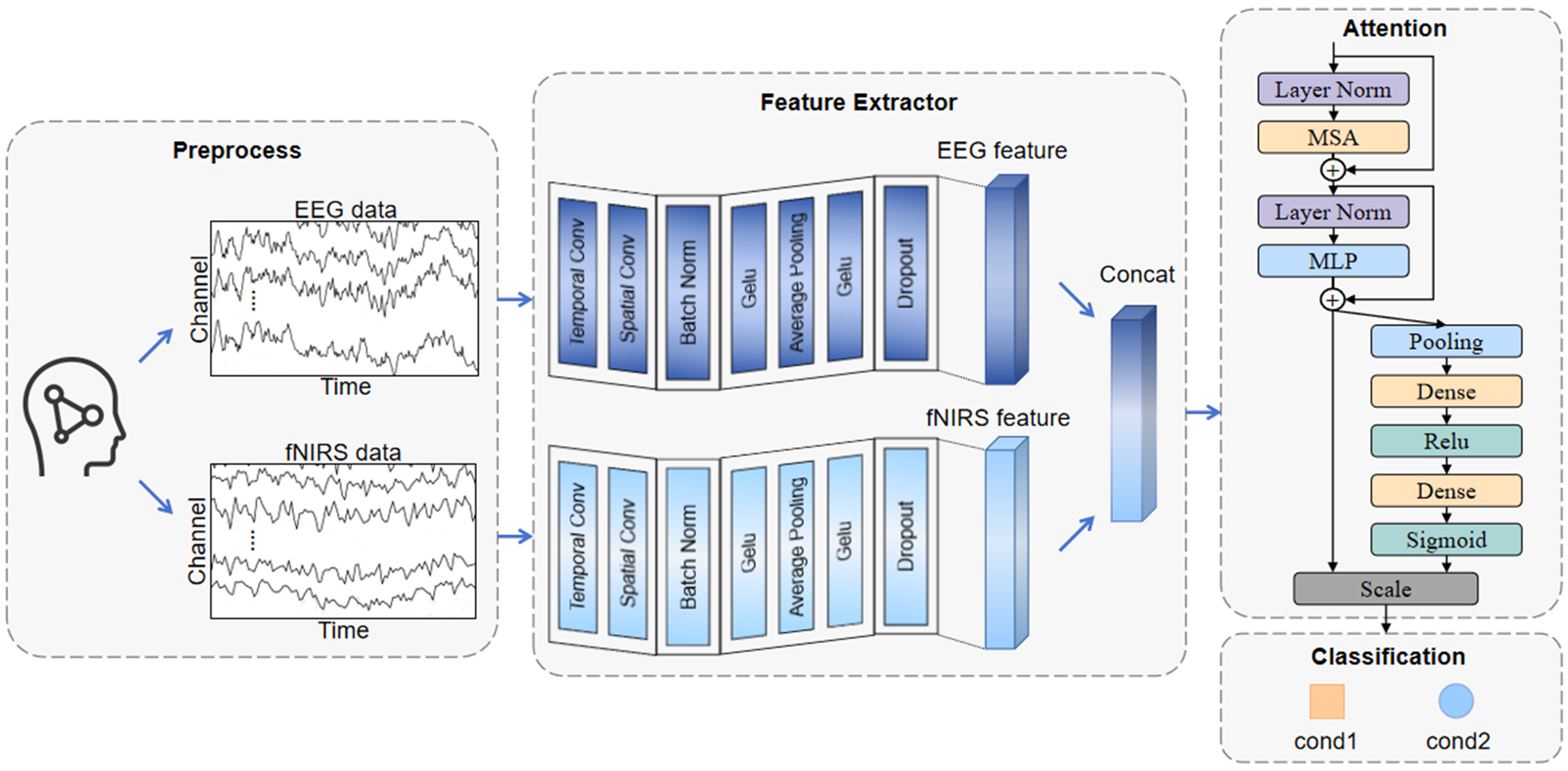

為了研究如何通過融合信號提高分類效率,研究團隊提出了一種融合時空卷積和注意力機制的網絡(ST2A)。相關研究成果以“Fusion analysis of EEG-fNIRS multimodal brain signals: a multitask classification algorithm incorporating spatial-temporal convolution and dual attention mechanisms”為題,發表在工程技術領域知名期刊《IEEE Transactions on Instrumentation and Measurement》(IF 5.6,中國科學院二區,Top期刊)上。

ST2A網絡由三個基礎部分組成:信號預處理模塊、特征提取模塊和注意力計算模塊。首先是對兩種信號的預處理,保留EEG和fNIRS信號的關鍵部分,轉換成可以輸入進神經網絡的特征形式并將信號對齊。然后分別對EEG和fNIRS信號進行時空特征提取,得到兩個信號的高級特征,并進行順序拼接。再利用Transformer編碼器和SE模塊進行雙重注意力計算。實驗結果表明所提出的網絡獲得了最先進的性能,也證明了該網絡在信號融合領域的通用性。

論文鏈接:https://ieeexplore.ieee.org/document/10886982

在所有腦機接口范式中,運動想象(MI)允許用戶通過想象運動而不是實際執行動作來控制外部設備。EEG信號和fNIRS信號是從大腦獲取MI信號的兩種更流行的神經成像技術。然而,由于EEG或fNIRS的局限性,基于MI的單模態信號分類方法的性能較低。

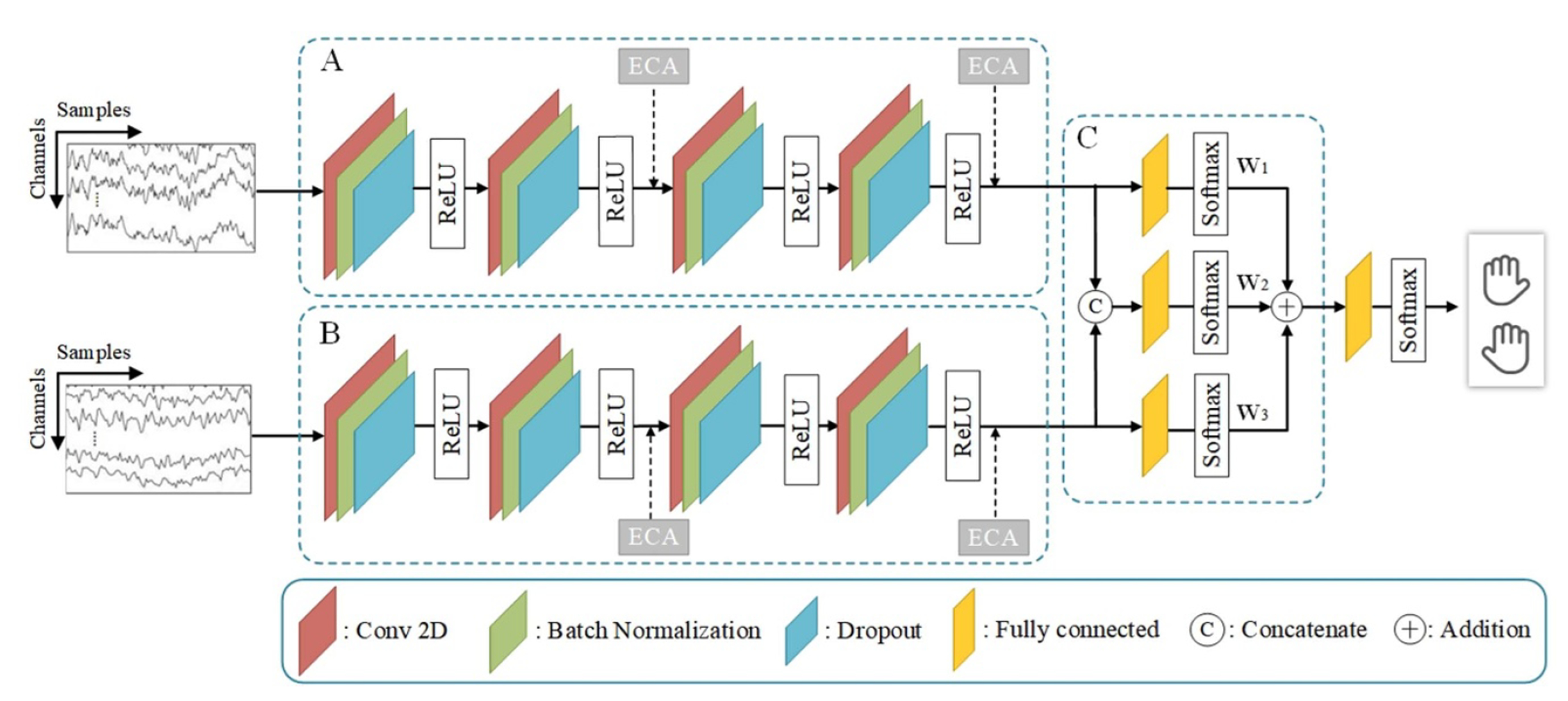

為了解決單模態信號分類和多模態信號融合分類的性能不佳的問題,研究團隊提出了一種混合EEG-fNIRS信號的ECA-FusionNet分類網絡。相關研究成果以“ECA-FusionNet: A hybrid EEG-fNIRS signals network for MI classification”為題,發表在工程技術領域知名期刊《Journal of Neural Engineering》(IF 3.7,中國科學院三區)上。

ECA-FusionNet分類網絡能夠結合EEG和fNIRS潛在的互補優勢。采用特征提取網絡從基于EEG和fNIRS的MI信號中提取時空特征;在特征層和決策層先后融合了EEG和fNIRS,以提高模型的適應性和魯棒性。該研究成果為多模態信號融合分類領域提供有益的參考。

論文鏈接:https://iopscience.iop.org/article/10.1088/1741-2552/adaf58